울산과학기술원(UNIST) 컴퓨터공학과 이슬기 교수 연구팀은 오토튜닝(자동 최적화) 속도를 CPU 기준 평균 2.5배, GPU 기준 평균 2배 단축하는 ‘베이지안 코드 확산(Bayesian Code Diffusion)’ 기법을 개발했다고 12일 밝혔다.

이번 연구는 컴퓨터 시스템 분야 세계 최고 권위 학회 중 하나인 OSDI(Operating Systems Design and Implementation)에 채택됐다.

OSDI에 한국인 주저자 논문이 오른 것은 20여 년간 단 12건뿐이며, 올해는 UNIST와 서울대 두 건만 국내에서 채택됐다.

|

AI 모델이 실제로 작동하려면, 사람이 작성한 고수준의 프로그램을 GPU나 CPU가 이해할 수 있는 저수준 코드로 변환하는 ‘컴파일’ 과정이 필요하다.

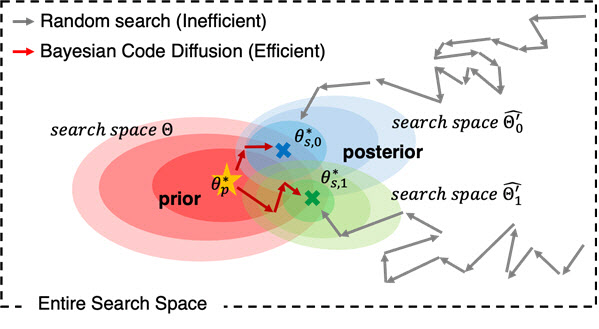

이 과정에서 오토튜닝은 수십만 가지 코드 조합 중 가장 효율적인 구성을 자동으로 찾지만, 기존 방식은 시간이 오래 걸리고 전력 소모가 큰 한계가 있었다.

연구팀은 딥러닝 모델 내부에 반복되거나 구조가 유사한 계산 단위(서브그래프)가 많다는 점에 착안했다. 기존 기법처럼 모든 구조를 각각 최적화하는 대신, 대표 서브그래프 하나만 최적화해 그 결과를 유사 구조에 ‘확산’시키는 방식으로 검색 범위를 대폭 줄였다.

여기에 베이지안 탐색 기법을 적용해 가능성이 높은 영역만 집중적으로 탐색, 최적의 코드를 빠르게 찾았다.

|

실험 결과, 기존 오토튜닝 프레임워크(Ansor)에 이 기법을 적용하면 동일 성능의 실행 코드를 만드는 데 걸리는 시간이 CPU 평균 2.5배, GPU 평균 2배 빨라졌다. GPU·CPU 사용 횟수 자체도 줄어 제한된 연산 자원을 효율적으로 쓰고, 전력 소모를 줄이는 효과도 확인됐다.

이슬기 교수는 “대규모 AI 모델 개발·배포 속도를 높이고, 하드웨어 자원과 에너지 절감에도 기여할 수 있다”며 “AI 시스템의 탄소 발자국 감소에도 도움이 될 것”이라고 말했다.

OSDI 채택의 의미

OSDI는 SOSP와 함께 컴퓨터 시스템 분야 양대 학회로, 구글의 ‘텐서플로(TensorFlow)’ 등 굵직한 AI 기술이 발표된 무대다. 올해 OSDI에는 338편의 논문이 접수됐고, 48편만이 채택됐다. 학회는 지난 7월 7~9일 미국 보스턴에서 개최됐다.

논문명은 ‘Bayesian Code Diffusion for Efficient Automatic Deep Learning Program Optimization’이다. 제1저자는 UNIST 정이수 연구원이다. 연구는 과학기술정보통신부와 정보통신기획평가원(IITP)의 지원으로 진행됐다.

![“덩치 큰 남성 지나갈 땐”…아파트 불 지른 뒤 주민 ‘칼부림' 악몽[그해 오늘]](https://image.edaily.co.kr/images/vision/files/NP/S/2026/03/PS26031000001t.jpg)