|

구체적으로 보면 네이버 ASF는 AI 시스템이 초래할 수 있는 위험을 △‘통제력 상실 위험’ △‘악용 위험’ 두 가지로 정의하고 이에 대한 대응 방법을 설계한다.

인간이 AI 시스템에 영향을 미치지 못하게 되는 통제력 상실 위험을 완화하기 위해 ‘AI 위험 평가 스케일’을 통해 AI 시스템의 위험을 주기적으로 평가하고 관리한다.

현존 최고 성능의 AI 시스템을 ‘프런티어(frontier) AI’로 정의하고 기술 수준에 해당하는 AI 시스템에 대해 3개월마다 위험 평가를 수행한다. 이와 별도로 시스템의 능력이 기존보다 6배 이상 급격히 증가한 경우에도 그 시점에 추가 평가를 진행한다.

네이버 ASF 활용 사례, 외부에 공개 방안 검토

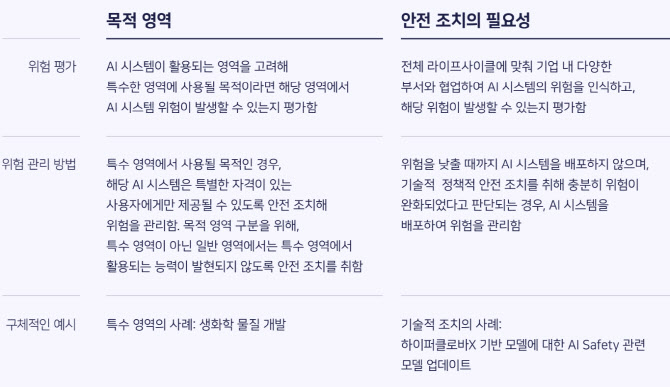

네이버 ASF가 정의하는 AI 시스템의 또 다른 잠재적 위험인 ‘악용’의 가능성에는 ‘AI 위험 평가 매트릭스’를 적용해 대응한다. AI 위험 평가 매트릭스는 AI 시스템의 사용 목적과 안전 조치의 필요성 정도에 따라 각각 다른 방법으로 위험을 관리한다.

가령 생화학 물질 개발과 같이 특수한 목적으로 사용되는 AI 시스템은 특별한 자격이 있는 사용자에게만 제공해 위험을 완화한다. 또 사용 목적과 관계없이 안전 조치의 필요성이 높은 AI 시스템이라면 추가적인 기술적·정책적 안전 조치를 통해 위험이 완화될 때까지는 배포하지 않는다.

네이버는 네이버 ASF 활용 사례를 리포트 등의 형태로 외부에 공개하는 방안을 고민하고 있다. 기술 발전에 따른 네이버 ASF의 지속적인 개선과 안전한 AI 생태계 조성한다는 차원에서 외부에 공유하는 노력을 이어간다는 계획이다.

|

AI 안전성 체계 설계 국내 첫 사례

네이버는 문화적 다양성을 반영한 AI 안전성 체계로 네이버 ASF를 발전시켜 나갈 계획이다. 한국 외 다른 지역의 정부 및 기업과 소버린(Sovereign) AI를 공동 개발하며 특정 문화권에서 성립될 수 있는 AI 시스템의 위험을 식별하고 위험의 정도를 측정하는 벤치마크(benchmark)도 문화권의 특성을 반영해 고도화할 방침이다.

네이버는 한국어를 기준으로 구축한 AI 안전성 강화 학습 데이터셋을 글로벌로 확장해 나간 경험이 있다. 지난해 세계 최고 권위 자연어처리 학회 중 하나인 ‘ACL 2023’에서 네이버는 종교·도덕 등 사회적으로 첨예한 이슈에 대해 AI가 편향적으로 발화하는 문제를 완화하기 위한 새로운 대량의 한국어 데이터셋을 제안한 연구를 발표하기도 했다.

해당 연구에서는 문화권에 따라 사회적으로 민감한 문제가 달라질 수 있다는 점을 고려해 같은 종류의 데이터셋을 다른 언어 기반으로도 구축할 수 있도록 데이터 설계 프로토콜을 함께 제안했고 글로벌 AI 커뮤니티에 기여했다는 평가와 함께 학계의 주목을 받았다.

최수연 네이버 대표이사는 “네이버는 한국에서 하이퍼클로바X라는 소버린 AI 개발 경험을 통해 문화적·지정학적 상황과 지역적 이해가 AI의 성능뿐만 아니라 안전성에도 영향을 미친다는 점을 실증했다”며 “향후 글로벌 시장에서도 소버린 AI를 개발하며 네이버 ASF를 지속적으로 개선해 나갈 계획”이라고 밝혔다.

그러면서 “이를 통해 다양한 지역의 문화와 가치를 반영하는 다수의 AI 모델이 안전하게 사용되며 공존하는 지속 가능한 AI 생태계에 네이버가 적극적으로 기여할 것”이라고 덧붙였다.

.png)

!['개과천선' 한국판 패리스 힐튼 서인영의 아파트[누구집]](https://image.edaily.co.kr/images/vision/files/NP/S/2026/05/PS26050300075t.jpg)